针对药物设计的政策不适用于人工智能

在许多方面,英国政府上个月推出的医疗保健人工智能(AI)系统的新行为准则是及时和必要的。卫生和社会关怀部制定的原则旨在保护患者数据并“确保只使用最好,最安全的数据驱动技术”(参见go.nature.com/2gqri5g)。该代码涵盖的项目包括由支持Alphabet的AI公司DeepMind所做的努力,该公司一直与伦敦的Moorfields眼科医院合作,通过一百多万次眼部扫描来设计一种可以检测黄斑变性的算法,以及Ultromics和英国牛津的John Radcliffe医院正在使用AI来改善心脏病和肺癌的早期检测。

然而,我担心可能成为全球基准的准则预示着大量的政策不足以规范人工智能。该准则揭示了人工智能如何改变医疗保健,社区和社会的缺乏认识,而是坚持医疗干预对个人隐私,安全和功效的影响的传统评估。

人工智能的影响更类似于汽车或个人电脑,而不是医药。向患者开处药物,其用途与个人需求相关。但汽车已经塑造了我们所有的生活,城市和工业 - 甚至对于那些不开车的人来说也是如此。围绕创新和技术的政策在很大程度上忽视了科技公司不平等恶化的可能性,即使这些例子越来越多。纽约州立大学奥尔巴尼分校的政治学家Virginia Eubanks创造了“数字贫民窟”这一短语来描述人工智能和自动化对低收入家庭和社区的影响。例如,加利福尼亚州洛杉矶市使用一项计划将无家可归者与适当的住房相匹配; 为了获得庇护,鼓励个人说出自己的名字,他们是否与陌生人进行过无保护的性行为或者是否认为是自我伤害,以及他们多久经常接受性侵犯或家庭虐待的危机服务。中产阶级社区不会容忍这种程度的入侵。当这些数据由警察和公共服务部门协调时,不公平的可能性在很多方面都会膨胀。

我在伦敦大学学院学习科学与社会之间的关系,我在伦敦艾伦图灵研究所考虑数据伦理和医疗保健AI。扩大不平等的风险并不是一个无法控制的规则的副作用; 它嵌入在技术本身中。例如,大多数数字公司通过生产和销售商品而没有巨大的制造和分销成本而获得成功。这提高了高技能工人的工资,同时减少了对他人的需求和条件。

我们已经可以收集技术如何改变医疗保健系统。2017年底,伦敦的Babylon Health推出了一款智能手机应用程序,可以提供医生咨询。皇家全科医师学院批评巴比伦“选择樱桃病患者,让传统的全科医生服务处理最复杂的病人,而没有足够的资源去做”。波士顿马萨诸塞州综合医院的放射肿瘤学家Anthony Zietman描述了质子束治疗的成本如何扭曲美国医疗保健市场并从其他领域引导资金,如传统放射治疗。我在伦敦国王学院的同事发现,对外科手术机器人的投资从其他治疗中获取资金,并在大型教学医院集中治疗,要求许多患者长途跋涉或放弃护理。

公众理解技术的利弊经常是密不可分的,评估技术意味着决定利益是否超过缺点,这样做取决于两者的分配方式。十多年来,我一直在使用焦点小组和参与式练习来衡量公众舆论 - 从干细胞到纳米科学这一主题 - 我已经看到了从个人到社会在多个互动尺度上如何感受到效果的复杂评估。人们担心技术将创造的世界,而不仅仅是对个人的伤害。我们的政策必须表现出类似的复杂性。

对我来说,英国的代码错失了机会,正确地开展工作,预测更广泛,不可避免的问题,并保持卫生系统的可负担性和有效性。正是由于全面的国家卫生服务,英国拥有超过七十年的数据 - 这对于开发医疗保健的人工智能至关重要。但这些相同的数据也警告说,社会不平等通过增加压力对所有人的身心健康产生不利影响,并且记录了贫困对大脑和身体的生物学影响。

技术可以改善医疗保健,加快诊断并降低成本。但要实现这一潜力,我们需要扩大我们评估它们的镜头,并且很快。

这不简单。随着汽车的出现,将出现许多严重的影响,并且由声音最弱的社区承担最严重的影响。我们需要将我们的目光从个人转移到系统再到社区,然后再回来。我们必须汇集各种专业知识,包括工人和公民,以制定卫生系统可用于预测和解决问题的框架。该框架需要明确授权,以考虑和预测AI的社会后果 - 并密切关注其影响。这是确保卫生技术满足所有人需求的最佳方式,而不仅仅是硅谷的需求。

推荐内容

-

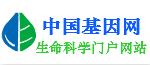

帕金森病在阑尾切除术患者中更普遍

根据一项新的研究,阑尾切除术增加了患帕金森氏病的风险,帕金森氏病是继阿尔茨海默氏病之后第二大最常见的神经退行性疾病。最近的研究...

-

偷走幸福的消极心理_偷走幸福有何消极心理

随着社会压力的不断加大,人们现在把越来越多的目光放到了一个人的心理情况上。确实,每个人的抗压指数是有限的,一个平时看着正常的人...

-

什么是踢猫效应

今天也是照常给大家说说心理方面的常识。很多人提到心理这两个字是没有概念的,以为这个东西是不需要去在意的。其实不然,随着科学知识...

-

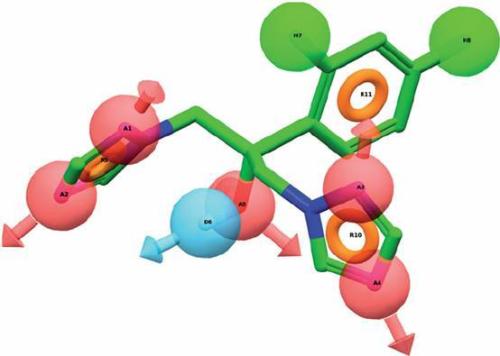

深度学习方法可能导致新的生物标志物和治疗目标发现

费城儿童医院(CHOP)的科学家表示,他们开发了一种计算工具,为研究人员提供了一种新技术,用于检测从DNA复制后RNA被剪接的不同方式。研究人

-

来自肠道细菌的化学物质在老化动物中保持活力

科学家们发现,由肠道细菌制成的一类化学物质,即吲哚,可以帮助蠕虫,苍蝇和老鼠保持更多生命的活动性和恢复力。研究结果定于8月21日在PNA

-

帮单亲孩子建立健康心态

家家都有本难念的经,特别是有小孩的家庭。在和孩子相处的过程中很多家长都在不断学习,怎么跟孩子交流起来更有效,怎么不跟孩子发脾气...

-

家长别破坏孩子的专注力

有些父母老是喜欢说别人家的孩子多好多好,其实也是别人家的父母当的好,教育的好,孩子才会出色呀。有时候家长需要自我反思,自己是不...

-

成长3阶段 心理健康关键词

都说现在的小孩子是越来越难教育了。好像从小就有自己的想法,不听爸爸妈妈的话,有时候还老是对着和你干 婴儿心

-

怎样才能不脸红

现在的人们越来越物质化了,什么都要攀比,其实生活是自己的,过得开不开心只有自己知道。有时候我们真的不需要在意别人的眼光,做自己...

-

《今夕何夕》的主要角色人物演员表介绍 人物关系是怎样的

想必大家在小的时候,业余生活大多都是靠电视剧消遣。尽管那时电视机还没有普及,人们走家串户,有的甚至不辞劳苦,走出二三里地,去别...